昨晚凯时体育游戏app平台,刷新闻时看到:

DeepSeek 独创东说念主梁文峰还是回广州旧地过年了。研讨词,在 2025 年 1 月 27 日凌晨(除夕夜)前夜,他们团队发布了一款新模子:多模态框架 Janus-Pro。

一又友在社群中吐槽说念,估量他是想以中国东说念主的神色,和好意思国 AI 圈沿途庆祝春节。

这款模子一发布,让蓝本就爆火的 DeepSeek 又一次成为了焦点。黄仁勋看了可能齐想说:一晚上干掉我几千亿市值,年青东说念主不讲武德,下手没个轻重,真实还在除夕夜搞事情。

不外,吐槽归吐槽,模子如实值得关切。我不是时代从业者,但可以把本人的清醒陈述给你。

一

统统陈述一共有四点。第少量是:DeepSeek Janus-Pro 是什么?

它是一款先进的多模态清醒和生成模子,是之前 Janus 模子的升级版。浅易讲,这个模子粗略同期处理文本、图像,即可以清醒图片内容,也能文生图。

为什么叫这个名字呢?

在罗马传说中,Janus(雅努斯)是标志着矛盾和过渡的双面看管神,他有两副模样,一副看着畴昔,一副看着将来,标志着初始和终结。

这个模子缱绻理念是双重的,能清醒图像又能生成图像,是以,它相配贴切模子的双重才智,才叫:雅努斯。

问题来了,之前有 Janus,为什么还要推出 PRO 版?

陈述中提到,目下多模态模子虽然还是很强横,但处理复杂的任务时,还有诸多不及,有些模子在清醒图片内容时进展可以,但生成图片可能不雄厚,要么细节处理不到位、甚而形貌和遐想的不一样;为了处治一系列问题,因此,才推出 Janus-Pro 版。

既然这么,Janus-Pro 版接受什么样的架构呢?

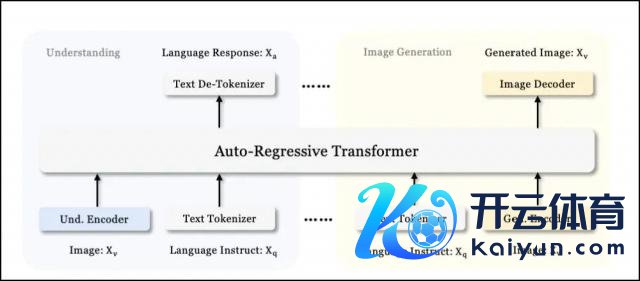

官方说:合座架构的中枢缱绻原则是,将多模态理罢免务和视觉生成任务的视觉编码进行解耦;咱们应用沉静的编码步伐将原始输入挪动为特征,然后,通过和洽的自追念变换器进行处理。

图释:Janus-Pro 模子架构默示图,如何分离处理清醒图像和生成图像的任务

这段话比较复杂。我举个例子:

目下有个超等机器东说念主叫 Janus-Pro。它的大脑被缱绻成两个部分,一个戒备清醒图片,另一个戒备凭证翰墨形貌来画画。

当机器东说念主看到一张图短暂,会用一个绝顶的"眼睛"(叫 SigLIP 编码器)来仔细不雅察图片,然后,把看到的内容形成一串数字(高维语义特征)。

这些数字像图片的"指纹",能匡助机器东说念主清醒图片里有什么。接下来,数字会被整理成一行,通过一个翻译器(适配器)挪动成机器清醒的语言。

当机器东说念主需要凭证翰墨形貌画面时,它会用另一个用具(叫 VQ tokenizer)把图片形成一串代码(闹翻 ID)。这些代码,就像图片的"密码",机器东说念主可以凭证密码重建相片。

紧接着,代码也会被整理成一行,通过另一个"翻译器"(生成适配器)挪动成机器东说念主能清醒的语言;终末,机器东说念主把两部分信息(清醒图片的内容和凭证翰墨形貌画画的信息)和归并在沿途,通过大脑(语言模子)来处理,终末,机器就能看到你要的东西了。

浅易讲,有四步:清醒相片、提真金不怕火谚语义、挪动成机器东说念主看得懂的东西、归并成你想要的东西。这是第一部分,它是什么?它的架构什么样。

二

那么,它是若何老练出来的呢?一共有三个阶段:

第一阶段,专注于老练适配器和图像头部。第二阶段处理和洽预老练,第三阶段,监督微调。但我认为,这么清醒比较复杂。

打个譬如:

你目下正在教一个小孩学画画。一初始,你不会径直让他画一幅复杂的气候画,而是先让他熟悉画浅易的时局,比如圆圈、正方形。等他把基本时局画得熟练了,再逐步增多难度,让他画更复杂的东西。Janus-Pro 的老练亦然这么的。

第一阶段,打基础。就像让小孩熟悉画"基本时局"一样,Janus-Pro 会先专注于学习图像基本特征,比如神志、线条等。

这个阶段的老练设施增多了,模子才有更多时辰学习基本特征,如斯一来,即便在固定的语言模子参数下,模子也能有用模拟像素的限定,凭证类别生成合理的框架。

到了第二阶段,增强难度。

当小孩粗略熟练画出基本时局后,就可以初始画更复杂的东西了。相通,Janus-Pro 在这个阶段。会初始处理更复杂的任务,比如:凭证文本形貌生成图像。

这个阶段的老练数据也作念了优化,径直使用往常的文本到图像数据,提高了老练着力,这么,模子粗略更高效地讹诈文本到图像数据,从而培植了合座性能。

第三阶段,试验效果。

就像让孩子插足画画比赛,试验他的学习效果一样,Janus-Pro 在这个阶段会同期处理多模态理罢免务和文本到图像生成任务,进一步优化模子的性能。

比如:将多模态数据、纯文本数据和文本到图像数据的比例从 7:3:10 治愈为 5:1:4,进一步培植模态的清醒才智。

在数据上,官方提到:

在 Janus-Pro 中,咱们加入了约莫 7200 万样本的合成好意思学数据,使得和洽预老练阶段中委果数据与合成数据的比例达到 1:1,这些合成数据样本的指示是公开可用的。

实考讲解,模子在合成数据上老练时,管理速率更快,生成的文本到图像输出不仅更雄厚,况兼在审好意思质料上也有显赫培植。

说白了,我认为,这三个设施,若是总结归纳的话,用中国话叫:比着葫芦画瓢。

问题来了:光画不够,因为,小一又友想画出一幅好画,必须要学许多东西,去清醒寰宇,看各式各种的动物、相片,才有概括的才智。

若何办?

为了提高 Janus-Pro 在职务中的进展,团队增多了无数的图像字幕数据、表格图表、以及文档清醒数据;这些数据,能让模子有契机学习不同的东西。这叫:多模态清醒数据的才智。

然后,团队又增多了无数的合成好意思学数据。这些数据让模子,有更多契机学习如何生成高质料的图像,从而提高模子的生成才智。

因此,"比着葫芦画瓢连"加上学习,它才能在日常中更出色。

三

然则,光特等据和学习才智还不够,就像小一又友要长大,需要握住培植默契才智一样,Janus-Pro 也要"长大"。那么,它是若何"长大"的呢?

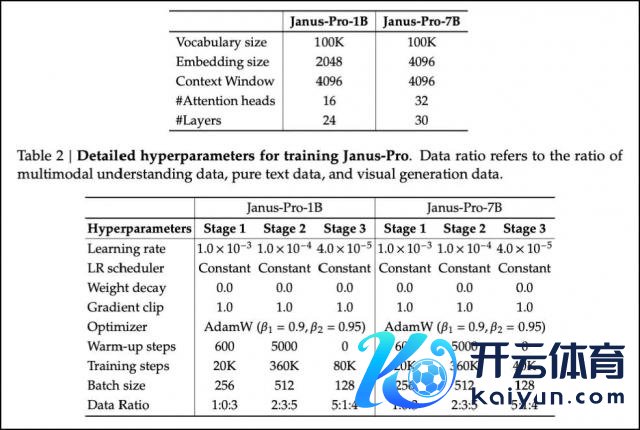

官方提到,先前版块使用的是 1.5B 语言模子,考证了视觉编码解耦的有用性。而在 Janus-Pro 中,团队将模子延伸到了 7B,并对 1.5B 和 7B 语言模子的超参数进行了优化。

具体来说,1.5B 模子的镶嵌大小为 2048,凹凸文窗口为 4096,慎重力头数为 16,层数为 24。而 7B 模子的镶嵌大小为 4096,凹凸文窗口为 4096,慎重力头数为 32,层数为 30。

看到这些数字,你可能会以为头大。其实,参数可以概括地清醒为模子"大脑"的升级:

镶嵌大小:就像模子"牵记容量",越大,能记取的信息就越多

凹凸文窗口:就像模子"视线范围",越大,能看到的凹凸文信息就越丰富

慎重力头数:就像模子"慎重力焦点",越多,能同期关切的细节就越多

层数:就像模子的"念念考深度",越多,能进行的念念考就越复杂

通过升级,Janus-Pro 的"大脑"从一个小学生形成了一个大学生,才智获得了全面培植。

官方团队发现,使用更大界限的语言模子时,多模态清醒和视觉生成的亏蚀管理速率,显赫提高,与较小模子比拟,性能培植显着。这一发现,进一步考证了这种步伐的遒劲可延伸性。

说白了,更大模子就像一支更高等的画笔,粗略更精细地处理复杂的任务,生成更高质料的图像和更准确的清醒舍弃。

图释:Janus-Pro 模子超参数建树概览

那么,这些升级如何罢了呢?来望望老练经过。

官方提到:

Janus-Pro 使用了 DeepSeek-LLM 当作基础语言模子,这是一个因循最大序列长度为 4096 的遒劲模子。

关于视觉编码器,Janus-Pro 遴选了 SigLIP-Large-Patch16-384,这是一个粗略从图像中提真金不怕火高维语义特征的编码器。生成编码器的码本大小为 16,384,图像下采样因子为 16。

老练经过中,Janus-Pro 接受了多种优化政策;举例,使用了 AdamW 优化器,使得学习率在不同阶段逐步治愈。统统老练经过在 HAI-LLM 框架上进行,遒劲的硬件因循确保,Janus-Pro 粗略在短时辰内完成复杂的老练任务。

这些数据看不懂不渊博,我概括解释下:

你家小孩要插足一个画画比赛,你需要为他准备一套好用的画具,还得找一位教会丰富的敦厚来勾通他,对吧?

DeepSeek-LLM 像那套高等画具,粗略匡助 Janus-Pro 更好地处理复杂的任务。

AdamW 优化器,像教会丰富的敦厚,会凭证小孩的学习进程,逐步治愈涵养难度,让小孩在每个阶段齐能稳步逾越。HAI-LLM 框架就像是一个广阔亮堂的画室,为小孩提供了专注创作的环境。

有了挟制利诱的合座因循,Janus-Pro 才能纵情应回报杂的文本形貌,生成高质料的图像的任务。

四

表面虽然进击,执行进展才是试验模子才智的真处死式,有句中国话叫什么:是骡子是马,拉出来遛遛。那么,Janus-Pro 的执行进展如何呢?

来望望它的评估建立和与最新时代的比较。为了考证 Janus-Pro 的性能,团队进行了严格的评估,他们遴选了多个基准测试,包括多模态理罢免务和视觉生成任务。

多模态理罢免务:包括 GQA、POPE、MME 等。这些测试就像是让 Janus-Pro 看一幅画,然后形貌画里的内容,望望它能不行准确地清醒。

视觉生成任务:包括 GenEval 和 DPG-Bench。这些测试则是给 Janus-Pro 一个翰墨形貌,让它凭证形貌画出一幅画,望望它能不行画得像、画得好。

说白了,即是反复进行"看图语言"和"语言遐想图片"的双重测试。

那么,Janus-Pro 在这场"考试"中进展如何呢?咱们可以拿它和其他的"考生",也即是其他多模态模子——来作念比较。

发轫,多模态理罢免务上:

Janus-Pro 在 MMBench 基准测试中得分 79.2,杰出了其他一些着名的模子,比如 TokenFlow-XL(68.9)和 MetaMorph(75.2)。这像在一场画画比赛中,Janus-Pro 的画作获得更高的评价,阐明它在清醒图像内容方面如实很强横。

对了,TokenFlow-XL 是 ByteFlow-AI 团队拓荒的一个多模态模子,而 MMBench 由 Meta 公司拓荒;这两个对比充分阐明了 Janus-Pro 在多模态理罢免务中的最初地位。

图释:多模态清醒基准测试中不同模子性能对比

其次,在视觉生成任务上:

Janus-Pro 在 GenEval 基准测试中的得分(0.80),也杰出了 DALL-E 3(0.67)和 Stable Diffusion 3 Medium(0.74)等模子。

这像给 Janus-Pro 一个翰墨形貌,让它画出一幅画,舍弃它画得比其他模子更准确、更精采,阐明它在凭证翰墨形貌生成图像方面也很出色。

对了,DALL-E 3 是 OpenAI 拓荒的文生图模子,而 Stable Diffusion 3 Medium 无谓说了,人所共知,专注于生成高质料图片,绝顶在中瓜分辨率下进展出色。

是以,论断是什么?

一句话总结即:Janus-Pro 在这场"考试"中进展优异凯时体育游戏app平台,吊打部分行业头部模子。还有少量是:这些测试不是我方测的。是专科机构 gemimi 和 DPG bench 泰斗认证,在 hanggenface 开源官网更新。